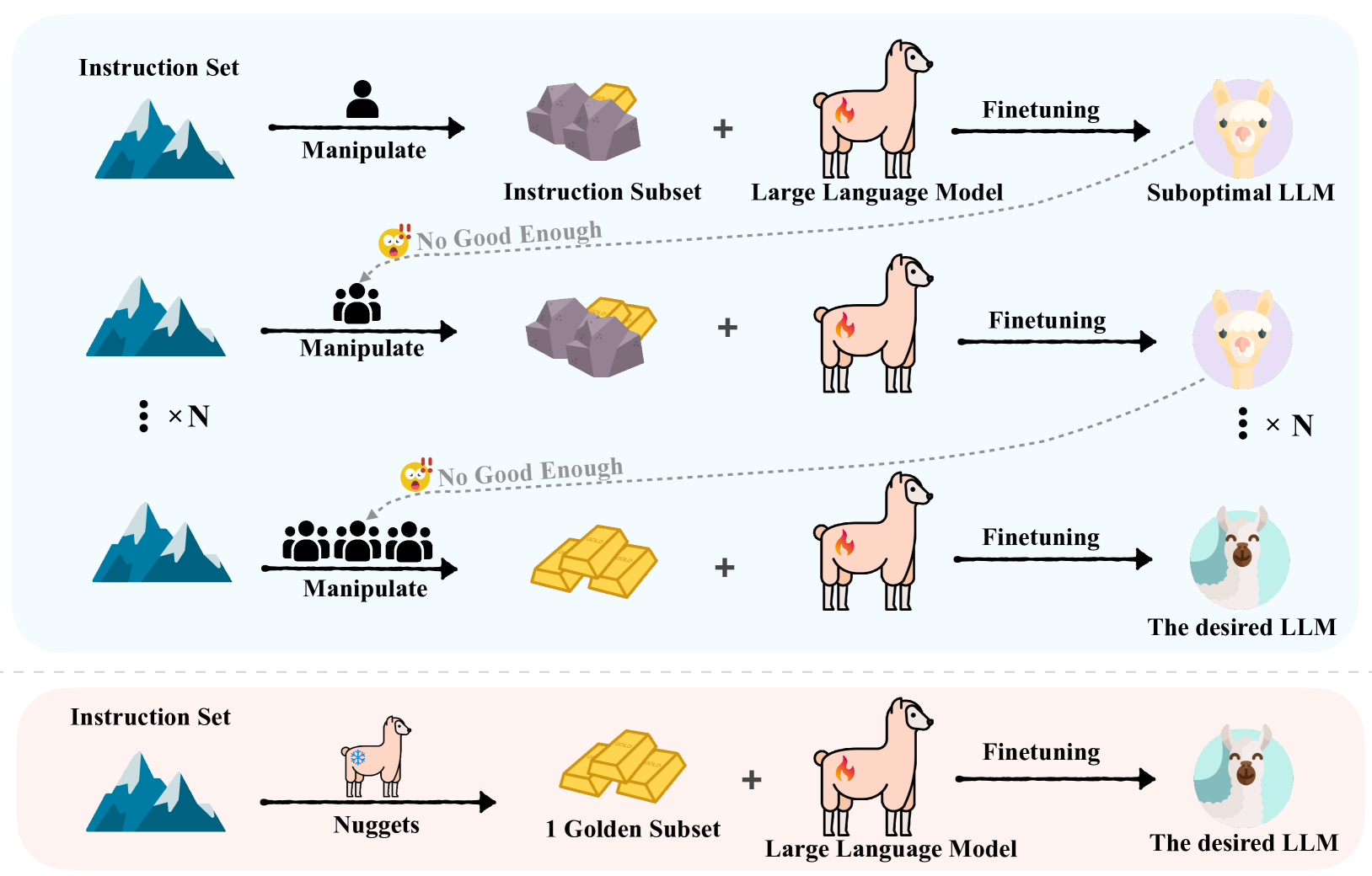

将大型语言模型 (LLM) 与人类结合起来是在各种语言任务中有效利用其预先训练的能力的关键一步。当前的指令调优实践通常依赖于扩展数据集大小,而没有明确的策略来确保数据质量,这可能会无意中引入噪声并降低模型性能。为了应对这一挑战,我们引入了 Nuggets,这是一种新颖且高效的方法,它采用一次性学习从广泛的数据集中选择高质量的指令数据 ...

正如 ChatGPT 所证明的那样,将大型语言模型 (LLM) 与人类偏好保持一致已被证明可以极大提高可用性并推动快速采用。监督微调(SFT)和人类反馈强化学习(RLHF)等对齐技术大大减少了有效利用 LLM 能力所需的技能和领域知识,从而提高了其在各个领域的可访问性和实用性。然而,像 RLHF 这样最先进的对齐技术依赖于高质量的人类反馈数据,这些数据的创建成本很高,而且通常仍然是专有的 ...

在李双代数和泊松李群的研究中引入了匹配的李代数对的概念。在本文中,我们介绍了一对匹配的李代数的表示和上同调。我们证明,从李双代数的上同调到相应匹配的李代数对的上同调之间存在态射 ...

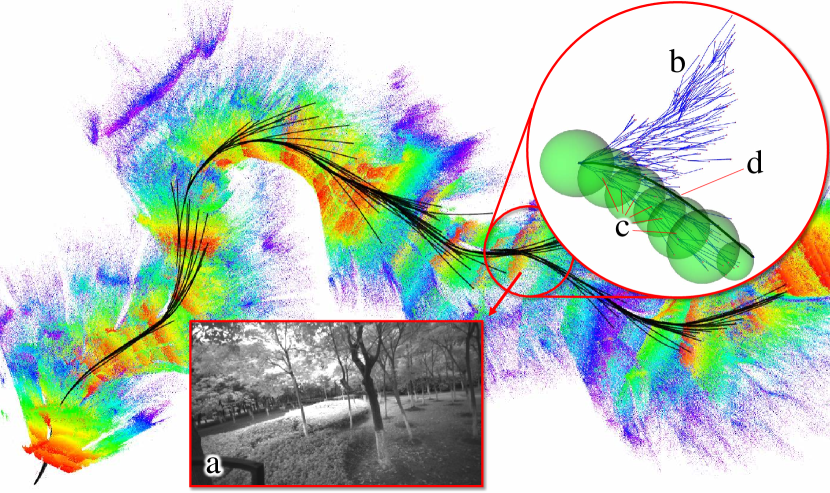

在线维护地图非常消耗资源,而强大的导航系统通常需要通过融合良好的地图进行环境抽象。在本文中,我们提出了一种无地图规划器,它直接对未融合的传感器数据进行这种抽象。提出了一种具有可靠邻近查询算法的有限内存数据结构来维护原始历史信息 ...

无监督地生成具有各种外观和可动画姿势的着装虚拟人体对于创建 3D 人体化身和其他 AR/VR 应用非常重要。现有的方法要么仅限于刚性对象建模,要么不具有生成性,因此无法合成高质量的虚拟人并为其制作动画。在这项工作中,我们提出了 AvatarGen,这是第一种不仅能够生成具有多种外观的非刚性人体,而且能够完全控制姿势和视点,同时只需要 2D 图像进行训练的方法 ...

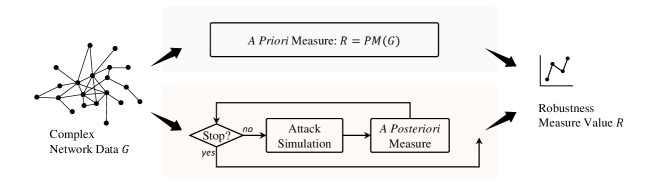

网络鲁棒性对于各种工业和社会网络抵御恶意攻击至关重要,它在不同的研究背景下具有不同的含义,在这里它指的是当网络的一部分因攻击而无法工作时网络维持其功能的能力。复杂网络研究的快速发展表明了人们对网络鲁棒性的特殊兴趣和高度关注,这对于进一步分析和优化网络结构以实现工程应用至关重要。这项全面的调查总结了网络鲁棒性研究的重要发现和发展,重点关注单层静态网络的后验结构鲁棒性度量 ...

在时间序列预测 (TSF) 领域,Transformer 始终表现出强大的性能,因为它能够关注全局上下文并有效捕获时间范围内的长期依赖性,以及辨别多个变量之间的相关性。然而,由于 Transformer 模型的效率低下以及围绕其捕获依赖关系的能力的问题,改进 Transformer 架构的持续努力仍在继续。最近,状态空间模型(SSM),例如 ...

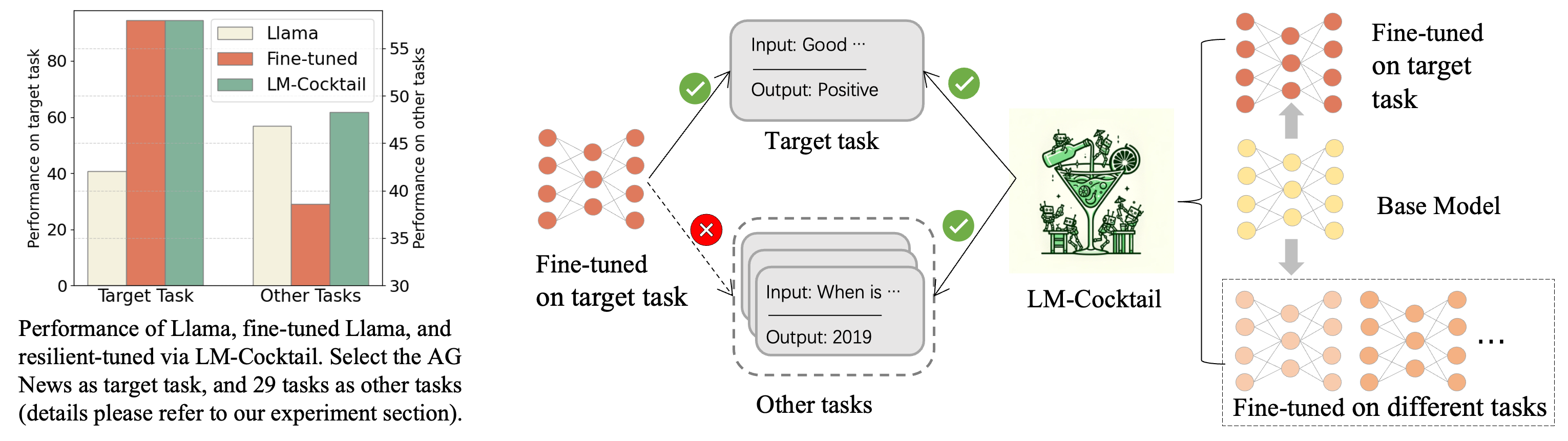

预训练的语言模型不断进行微调,以更好地支持下游应用程序。然而,此操作可能会导致超出目标域的一般任务的性能显着下降。为了克服这个问题,我们提出了 LM-Cocktail,它使微调后的模型能够在总体角度上保持弹性 ...